مقدمه

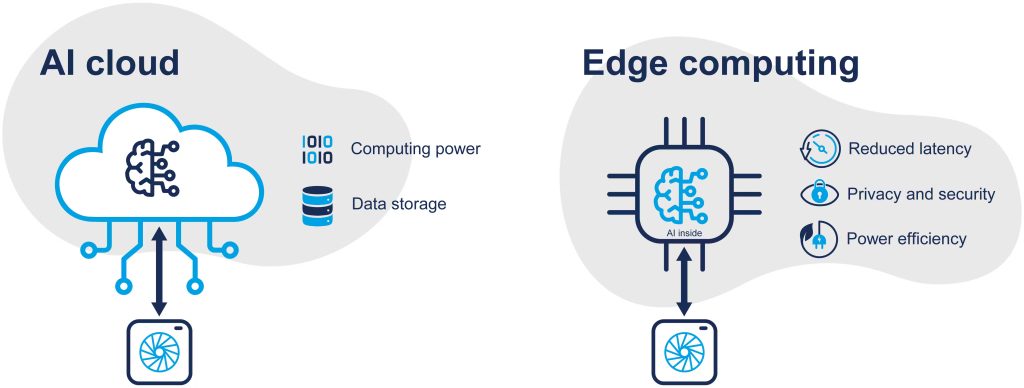

هوش مصنوعی لبه (Edge AI) انقلابی در پردازش دادهها ایجاد میکند و هوش مصنوعی را مستقیماً به لبه شبکه میبرد. این فناوری مدلهای یادگیری ماشین را روی دستگاههای لبه مانند سنسورها، دروازهها و سرورهای محلی اجرا میکند تا تأخیر را کاهش دهد و کارایی را افزایش دهد. با رشد اینترنت اشیاء (IoT)، شبکههای توزیعشده و مراکز داده، Edge AI آیندهای را ترسیم میکند که در آن تصمیمگیریهای هوشمند در نزدیکی منبع داده رخ میدهد. متخصصان حوزه فناوری اطلاعات، مهندسان شبکه و توسعهدهندگان AI این فناوری را به عنوان کلیدی برای حل مشکلات سنتی پردازش ابری میبینند. در این مقاله، فرصتهای نوظهور، چالشهای فنی و معماریهای ضروری Edge AI را بررسی میکنیم و ارتباط آن با IoT، شبکههای توزیعشده و مراکز داده را تحلیل میکنیم.

فرصتهای Edge AI در آینده هوش مصنوعی لبه

Edge AI فرصتهای بینظیری برای تحول صنایع فراهم میکند. توسعهدهندگان سختافزار نوآوریهایی مانند تراشههای نورومورفیک (مانند Intel Loihi) را پیش میبرند که پردازش رویدادمحور را روی دادههای پراکنده امکانپذیر میسازد و مصرف انرژی را به سطح میکرووات کاهش میدهد. الگوریتمهای یادگیری مداوم مدلها را به طور افزایشی تطبیق میدهند و نیاز به آموزش مجدد در ابر را حذف میکنند، که این امر هزینههای استقرار در محیطهای پویا را پایین میآورد.

همکاری لبه-ابر یک پیوستگی شناختی ایجاد میکند؛ جایی که مدلهای TinyML دادهها را در دستگاه لبه فیلتر میکنند و پردازش پیچیده را به MEC (Mobile Edge Computing) منتقل میکنند تا تعادل بین تأخیر و مصرف انرژی برقرار شود. یادگیری فدرال (Federated Learning) ناوگانهای توزیعشده را برای آموزش حفظ حریم خصوصی بهرهبرداری میکند و بهروزرسانیها را بدون انتقال دادههای خام تجمیع مینماید – ایدهآل برای شبکههای ناهمگن IoT.

در شبکههای توزیعشده، فناوری 6G تأخیر زیر میلیثانیهای را فعال میکند و AI را در شبکههای دسترسی رادیویی (RAN) ادغام مینماید تا تخصیص منابع را بهینه کند. این پیشرفتها رباتیکهای گروهی و واقعیت گسترده (XR) را پشتیبانی میکنند. مراکز داده از تخلیه لبه سود میبرند؛ جایی که لبهها استنتاج را مدیریت میکنند و مراکز داده روی آموزش جهانی تمرکز مینمایند. این رویکرد مقیاسپذیری را در شهرهای هوشمند و IoT صنعتی افزایش میدهد و تحلیلهای زمانواقعی و نگهداری پیشبینیکننده را فراهم میکند.

چالشهای Edge AI در لبه شبکه

Edge AI با چالشهای فنی جدی روبرو است که متخصصان باید آنها را حل کنند. محدودیتهای منابع در سختافزار لبه (مانند میکروکنترلرها با رم کیلوبایتی) تعادل بین دقت مدل و تأخیر/انرژی را تحمیل میکند. تکنیکهای فشردهسازی مانند کوانتیزاسیون 3-5 برابر صرفهجویی انرژی ایجاد میکنند، اما دقت را کاهش میدهند.

امنیت در تنظیمات توزیعشده سطح حمله را گسترش میدهد؛ حملات فیزیکی، کانالهای جانبی و جعل بهروزرسانیهای فدرال نیاز به محیطهای اجرای معتبر (TEEs) و رمزنگاری هومومورفیک دارند. مدیریت مدل در ناهمگنی سختافزاری پیچیده است و بهروزرسانیهای OTA و کنترل نسخه در میلیونها دستگاه با اتصال متناوب را دشوار میسازد.

مصرف انرژی دستگاههای باتریدار را محدود میکند؛ DVFS، هرس (30-60% کاهش انرژی) و استنتاج رویدادمحور کمک میکنند، اما جریمههای دقت باقی میمانند. مسائل اتصال در شبکههای توزیعشده سربار یادگیری فدرال را افزایش میدهد و لینکهای نامطمئن انرژی را از طریق بافرینگ هدر میدهند. عدم تعاملپذیری استانداردهای غیریکنواخت ایجاد میکند و قفل فروشنده را تحمیل مینماید؛ ONNX تعامل را تسهیل میکند، اما پذیرش ناقص است.

در IoT و مراکز داده، این چالشها به هم متصل میشوند: محدودیتهای منابع پردازش MEC را محدود میکنند، امنیت در ناوگان توزیعشده مراکز داده را تهدید مینماید و ناهمگنی ادغام هیبریدی را پیچیده میسازد.

معماریهای لازم برای Edge AI

معماریهای Edge AI بر اساس لایههای استقرار ساختاربندی میشوند: لبه دستگاه (میکروکنترلرها برای استنتاج TinyML)، لبه شبکه (دروازهها/MEC برای همجوشی TinyDL)، لبه منطقهای (سرورها برای تحلیل چندسنسوری) و لبه ابر (آموزش هیبریدی). سختافزارها شامل ASICها (مانند Edge TPU برای TOPS/W بالا در استنتاج ثابت)، FPGAها (قابل پیکربندی برای نمونهسازی)، GPUها (موازیسازی در تحلیل ویدیو، پرمصرف) و نورومورفیک (ناهماهنگ برای دادههای پراکنده) هستند.

پشتههای نرمافزاری TensorFlow Lite/PyTorch Mobile را برای بهینهسازی، OpenVINO را برای اجرای ناهمگن و ONNX Runtime را برای استقرار چندپلتفرمی ارائه میدهند. پروتکلهای ارتباطی مانند MQTT/CoAP برای IoT محدود مناسب هستند، در حالی که 5G URLLC تأخیر پایین MEC را فعال میکند.

پارادایمها شامل TinyML (فشردهسازی شدید روی MCUها)، TinyDL (هرس/تقطیر روی SoCها)، TinyRL (فشردهسازی سیاست برای کنترل) و یادگیری فدرال (آموزش محلی، تجمیع بهروزرسانیها) میشوند. در شبکههای توزیعشده، سلسلهمراتب مه-MEC با IoT ادغام میشود تا دروازهها دادههای سنسور را تجمیع کنند. مراکز داده از هیبریدهای لبه-ابر استفاده میکنند و کنترلکنندههای AI تقسیم پویا را بر اساس شبکه/بار مدیریت مینمایند.

ارتباط Edge AI با IoT، شبکههای توزیعشده و مراکز داده

Edge AI با IoT ادغام میشود و هوش را در نقاط انتهایی جاسازی میکند تا جریانهای داده را زمانواقعی پردازش نماید. این فناوری کاربردهایی مانند نگهداری پیشبینیکننده (تحلیل ارتعاش روی سنسورهای کارخانه) و نظارت از راه دور (پوشیدنیها که ناهنجاریها را محلی تشخیص میدهند) را فعال میکند.

در شبکههای توزیعشده، MEC/مه تأخیر فوقالعاده پایین را برای همکاری فراهم میکند؛ مثلاً 5G پلاتونینگ خودرو یا بهینهسازی ترافیک شهر هوشمند از طریق دوربینهای لبه را پشتیبانی مینماید. یادگیری فدرال در ناوگانهای IoT حریم خصوصی را با آموزش روی دستگاه حفظ میکند.

ارتباط با مراکز داده شامل تخلیه است: لبهها استنتاج را برای تأخیر/حریم خصوصی مدیریت میکنند و مراکز داده روی آموزش/تجمیع جهانی تمرکز مینمایند. این پیوستگی پهنای باند را در استقرارهای مقیاس IoT کاهش میدهد و 6G بافت اتصالی را برای حسکردن به عنوان سرویس تقویت میکند، جایی که شبکهها زمینه ادراکی را به دستگاههای لبه ارائه میدهند. چالشهایی مانند ناهمگنی همه را تحت تأثیر قرار میدهند: دستگاههای IoT TinyML را محدود میکنند، شبکههای توزیعشده مسائل اتصال را تشدید مینمایند و مراکز داده تعادلهای ادغام هیبریدی را مواجه میسازند.

نتیجهگیری

Edge AI آینده هوش مصنوعی را در لبه شبکه بازتعریف میکند و فرصتهایی برای نوآوری در IoT، شبکههای توزیعشده و مراکز داده ایجاد مینماید. متخصصان با غلبه بر چالشهای منابع، امنیت و مدیریت، معماریهای پیشرفته را مستقر میکنند تا سیستمهای هوشمند، کارآمد و امن بسازند. این فناوری نه تنها تأخیر را حذف میکند، بلکه حریم خصوصی را تقویت مینماید و مقیاسپذیری را افزایش میدهد. برای ماندن در پیشرو، سازمانها باید سرمایهگذاری روی سختافزارهای نوین و پارادایمهای توزیعشده را اولویت دهند.